小红书首次开源文本大模型

田宁

2025-06-09 10:12

6月9日消息,小红书近日开源了首个大模型——dots.llm1。

dots.llm1是一个中等规模的Mixture of Experts(MoE)文本大模型,由小红书 hi lab(Humane Intelligence Lab,人文智能实验室)团队研发,总参数量 142B,激活参数 14B。

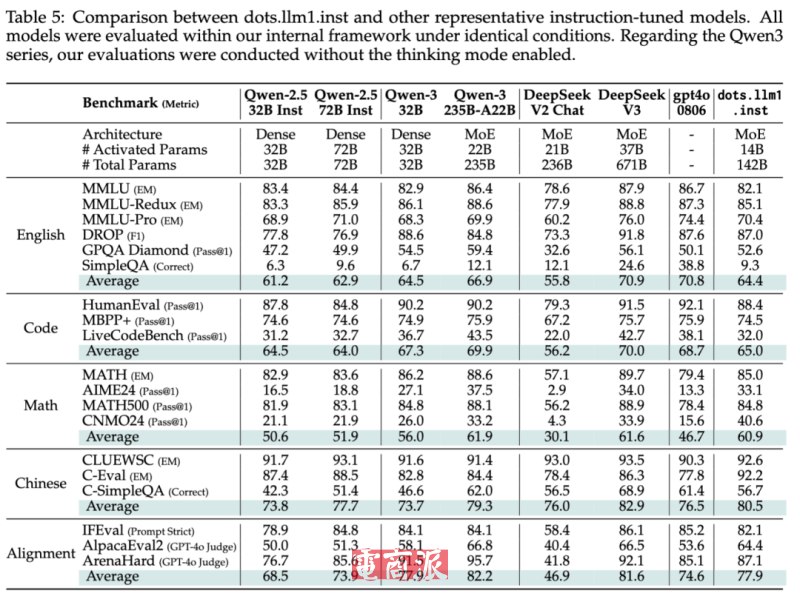

具体来说,在激活14B参数的情况下,dots.llm.inst模型在中英文通用场景、数学、代码、对齐任务上的表现亮眼,与 Qwen2.5-32B-Instruct、Qwen2.5-72B-Instruct相比具备较强的竞争力。同时与Qwen3-32B相比,在中英文、数学、对齐任务上表现接近。

图源:小红书

此外,dots.llm1最大特色是使用了11.2万亿token的非合成高质量训练数据,这在现阶段的开源大模型中非常罕见。

今年以来,小红书在AI、大模型方面的动作频频。年初,小红书内部大模型技术与应用产品团队升级为hi lab,并启动了“人文训练师”的招聘,邀请有深厚人文背景的研究者加入到对AI的训练中,将人类更全面的智慧和价值感注入AI,最终让AI成为人类有益的伙伴。

5月27日,小红书hi lab与复旦大学哲学学院共同成立“AI人文人才训练营”,展开AI后训练相关的人文课题共创,培养“AI+人文”复合型人才。大模型的训练通常分为预训练(pre-train)和后训练(post-train)两个阶段。人文训练就属于后训练的一部分,对AI在人性化表达、人类价值对齐等方面的表现起到关键作用。

图源:小红书

声明

1、该内容为作者独立观点,不代表电商派观点或立场,文章为作者本人上传,版权归原作者所有,未经允许不得转载。

2、电商号平台仅提供信息存储服务,如发现文章、图片等侵权行为,侵权责任由作者本人承担。

3、如对本稿件有异议或投诉,请联系:info@dsb.cn

2、电商号平台仅提供信息存储服务,如发现文章、图片等侵权行为,侵权责任由作者本人承担。

3、如对本稿件有异议或投诉,请联系:info@dsb.cn

田宁

电商脉搏,媒体前沿洞察。